Aucun produit dans le panier

Réutilisation de l’énergie thermique des centres de données : refroidissement à l’eau chaude

Dans cette série, nous explorons les différentes façons dont les opérateurs de centres de données tentent d'être des citoyens du monde responsables tout en garantissant un retour sur investissement à long terme en réduisant leur empreinte carbone grâce à la captation et à la réutilisation de l'énergie thermique produite par leurs équipements TIC. J'ai pris pour sujet de conversation un mois d'octobre 2011 MIT Technology Review article de Neil Savage, « Effet de serre : cinq idées pour réutiliser la chaleur résiduelle des centres de données ». Les cinq exemples qu’il cite dans cet article représentent en réalité cinq stratégies générales et je les considère donc comme un point de départ utile pour explorer les développements au cours des neuf années suivantes. Les idées étaient les suivantes :

Le centre de données de l'Université Notre Dame a chauffé une serre.

Un centre de données de l'Université de Syracuse produisait sa propre électricité et utilisait l'excès d'eau froide pour climatiser un immeuble de bureaux adjacent en été et l'excès d'eau chaude pour le chauffer en hiver.

Un centre de données de recherche IBM à Zurich a utilisé un refroidissement liquide à l'eau chaude et a utilisé l'eau de « retour » plus chaude pour chauffer un laboratoire adjacent.

Le laboratoire national d'Oak Ridge a développé un mécanisme fixé à un microprocesseur et produisant de l'électricité.

Un centre de données Telecity à Paris a fourni de la chaleur pour des expériences de recherche sur les effets du changement climatique.

Dans la première partie, nous avons examiné les variations de l'utilisation par l'Université Notre Dame de l'air chaud résiduel du centre de données pour entretenir une serre adjacente pendant les hivers du nord de l'Indiana. Bien que nous ayons couvert plusieurs exemples de réutilisation de l'air chaud, en général, la faible énergie de l'air entre 80 et 95 °F et l'exigence que l'application soit essentiellement adjacente au centre de données présentaient des obstacles raisonnables à un retour sur investissement attrayant. En examinant l'utilisation d'air usé à 80 °F provenant d'une salle UPS pour réduire l'augmentation de l'objectif de 100 °F des chauffe-blocs du générateur, nous avons déterminé qu'il était possible de démontrer que des pratiques efficaces de gestion du flux d'air permettant à un centre de données de fonctionner plus près de la limite supérieure recommandée par l'ASHRAE entraînerait une production d'air rejeté qui pourrait éliminer complètement le besoin de chauffe-blocs de générateur. Cet exemple aborde à la fois les obstacles liés à la qualité énergétique et à la contiguïté. Par ailleurs, nous avons constaté que les utilisations les plus efficaces de l'énergie thermique provenant de l'air de retour des centres de données se produisaient dans les réseaux de chauffage urbain locaux d'Europe du Nord et que plus de 10 % de l'énergie thermique de la Suède provenait des centres de données. En fait, les districts de chauffage locaux, sous une forme ou une autre, représentent un modèle utile pour une réutilisation efficace de l’énergie des centres de données, comme nous le verrons dans les discussions ultérieures.

J'ai inventé « l'exploitation de la boucle » pour la deuxième catégorie de réutilisation de l'énergie des centres de données, dans laquelle le côté alimentation de la boucle d'eau glacée pourrait être exploité pour un refroidissement auxiliaire et le côté retour pourrait être exploité pour le chauffage ou le refroidissement. Dans l'exemple de l'Université de Syracuse tiré de l'article de Savage, la principale source d'énergie à réutiliser était l'échappement de la turbine, qui était suffisamment chaud pour alimenter les refroidisseurs à absorption afin de fournir la climatisation du bâtiment, qui était exploité pour refroidir le centre de données, ou suffisamment chaud pour fonctionner. grâce à un échangeur de chaleur pour chauffer le bâtiment pendant l'hiver. Une étoile brillante plus actuelle pour « exploiter la boucle » est le projet Westin-Amazon à Seattle, qui impliquait une ingénierie un peu plus simple mais beaucoup plus de créativité dans la gestion globale du projet, nécessitant une collaboration entre diverses agences gouvernementales, services publics et entreprises poursuivant mutuellement leurs efforts. intérêt personnel bénéfique. Essentiellement, les immeubles de bureaux d’Amazon représentent l’équivalent d’un « client » de district de chauffage local pour Clise Properties (le propriétaire de l’hôtel Westin Carrier), et Clise Properties et McKinstry Engineering ont formé une entité enregistrée en tant que société de services publics agréée. Amazon évitera quelque 80 millions de kW-heures de coûts d'énergie de chauffage et Clise Properties évitera les dépenses liées au fonctionnement des tours d'évaporation et les dépenses liées à la perte d'eau qui en résulte. Alors que le modèle Westin-Amazon représente pour moi le modèle parfait pour un projet efficace de réutilisation de l'énergie d'un centre de données en boucle, un examen d'un projet similaire annulé au Massachusetts Institute of Technology a révélé la complexité d'essayer de rassembler tous les chats pour un tel projet. une entreprise que nous reverrons dans cette troisième partie de la série.

La troisième catégorie de réutilisation de l'énergie thermique des centres de données provenant du MIT Technology Review Il s'agit du refroidissement par eau chaude, qui peut bénéficier à l'une ou l'autre des deux premières catégories, mais qui est particulièrement bénéfique pour le refroidissement liquide des centres de données (qui gagne enfin du terrain dans notre secteur). Comme mentionné précédemment, si l'air vicié du centre de données est utilisé pour faciliter le démarrage du générateur, augmenter l'air d'alimentation de 65 ˚F ou 70 ˚F jusqu'à 78-80 ˚F produira une température de l'air de retour suffisamment élevée pour éliminer les chauffe-blocs. De plus, dans le projet Westin-Amazon, une bonne exécution du confinement du flux d'air du centre de données pourrait permettre d'augmenter suffisamment l'alimentation en eau du centre de données vers l'échangeur de chaleur du service public pour réduire de 28 % l'élévation de l'usine de récupération de chaleur. Dans aucun de ces cas, nous ne parlons de refroidissement avec de l’eau tiède ou chaude, mais même en déplaçant l’aiguille, ces petites étapes peuvent produire des avantages significatifs. Lorsque nous commençons à travailler avec de l’eau chaude, nous obtenons une énergie thermique perdue de meilleure qualité et l’eau est plus facile à déplacer que l’air.

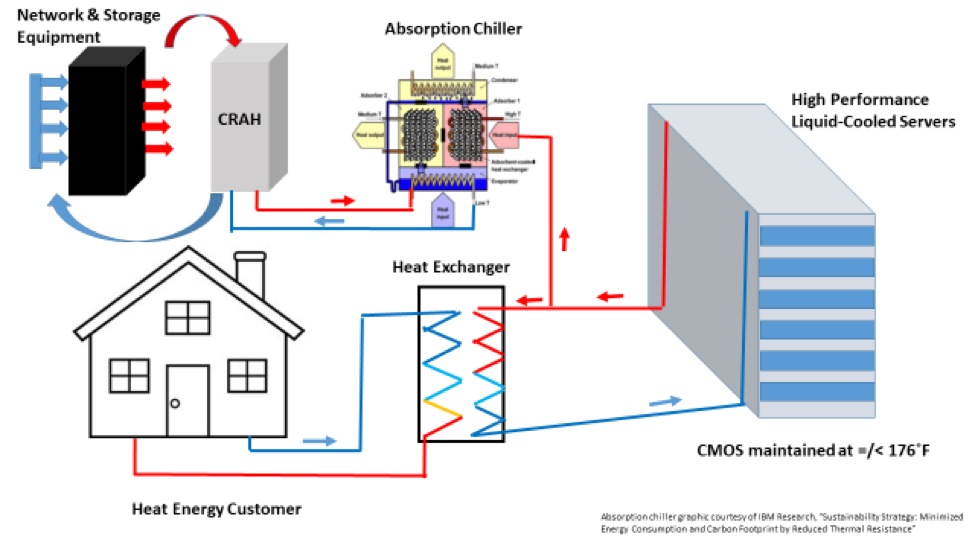

Le centre de données de validation IBM du laboratoire de recherche de Zurich a tiré parti des innovations en matière de refroidissement liquide par contact direct, dans lesquelles l'eau chaude était pompée à travers des microcanaux en cuivre fixés aux puces informatiques. Ils ont constaté qu'une eau d'alimentation de 140 °F maintenait la température des copeaux autour de 176 °F, soit en toute sécurité en dessous du maximum recommandé de 185 °F. Ce refroidissement à l'eau chaude a entraîné une température de « retour » post-traitement de 149 °F, ce qui représentait une énergie thermique adéquate pour le chauffage et le refroidissement du bâtiment via un refroidisseur à absorption, sans nécessiter une augmentation des pompes à chaleur. En plus de fournir de la chaleur à un laboratoire adjacent, le refroidisseur à absorption fournissait une capacité de refroidissement de 49 kW à environ 70 °F. Un aperçu simplifié de cette approche est illustré dans la figure 1 ci-dessous.

Figure 1 : Flux simplifié de réutilisation de l'énergie de refroidissement liquide du centre de données

À peu près au même moment où l'expérience IBM de preuve de concept de refroidissement par eau chaude et liquide était mise en œuvre en Suisse, eBay expérimentait le refroidissement par eau chaude à Phoenix dans le cadre du projet Mercury très médiatisé. Le projet Mercury impliquait une partie du centre de données refroidie par une boucle d'eau glacée connectée à des refroidisseurs, puis un deuxième centre de données utilisant l'eau de retour du condenseur du premier centre de données jusqu'à 87 °F pour alimenter les échangeurs de chaleur de porte arrière montés en rack. De toute évidence, les températures dépassaient les températures d'entrée d'air du serveur recommandées par l'ASHRAE, mais restaient dans la plage autorisée de classe A2. C'est dans le cadre de cette opération que Dean Nelson et son équipe ont mis au point une mesure d'efficacité du centre de données basée sur la mission de l'entreprise, liant les coûts du centre de données aux transactions de vente des clients, donnant ainsi forme à ce point de bascule illusoire entre l'efficience et l'efficacité du centre de données. Dans ce cas, le « client » était interne et la chaleur perdue n’était pas utilisée comme source d’énergie thermique mais comme source de refroidissement.

Le modèle du projet Mercury offre en fait une vision d'un refroidissement par eau chaude à faible risque qui pourrait être disponible dans de nombreux centres de données sans avoir à passer par une certaine forme de refroidissement liquide par contact direct. Par exemple, les centres de données utilisant des échangeurs de chaleur à porte arrière peuvent fonctionner avec des températures d'alimentation au nord de 65 °F, ce qui dépasse facilement la température de retour d'une boucle d'eau de retour de refroidissement de confort d'un bâtiment. Puiser dans l'eau de retour est essentiellement un refroidissement gratuit, puis pendant la période de l'année où le climatiseur du bâtiment peut ne pas fonctionner en continu (ou pas du tout, mes amis du Minnesota), les échangeurs de chaleur de la porte arrière peuvent être alimentés via un échangeur de chaleur à refroidissement gratuit. économiseur. Le même principe s’applique au refroidissement liquide par contact direct, qui devrait être essentiellement libre de fonctionner dans n’importe quelle installation avec n’importe quelle charge de refroidissement de confort de taille significative.

Plus récemment, IBM Zurich a traduit la validation de principe en un super ordinateur de production complète à Zurich (LRZ SuperMUC-NG), avec un projet parallèle à Oak Ridge, Tennessee. Bruno Michel, responsable de l'intégration des systèmes intelligents dans les laboratoires de Zurich, affirme que le superordinateur de production est en fait une installation à émissions négatives, car tous les équipements TIC sont alimentés par des énergies renouvelables et le chauffage et le refroidissement produits par le centre de données permettent d'éviter les émissions. Le profil de température des différentes étapes du processus illustré à la figure 1 varie en fonction de la situation et des exigences du client. Par exemple, pour refroidir le réseau et les équipements de stockage par temps chaud lorsque le refroidissement gratuit n'est pas disponible et pour fournir de l'énergie thermique utilisable aux réseaux de chauffage urbain par temps plus frais, le centre de données fonctionne à 149 °F. Pour fournir du chauffage au sol aux clients résidentiels, la température peut descendre jusqu'à 131 °F et pour prendre en charge le refroidissement gratuit à Oak Ridge, ils fonctionneront à 113 °F. Le refroidisseur à absorption Fahrenheit fonctionne avec une température d'entraînement de 127 °F pour fournir de l'eau glacée de 68 °F aux unités de refroidissement desservant les équipements de stockage et de réseau, avec une capacité de refroidissement totale de 608 kW.

Le projet IBM repose sur une innovation révolutionnaire dans la réduction de la résistance thermique, permettant ainsi une température de l'eau plus élevée au niveau de la puce, ce qui entraîne une réelle amélioration globale des performances de la puce. Néanmoins, chacune des diverses solutions de refroidissement liquide par contact direct disponibles sur le marché aujourd'hui peut offrir une partie importante des avantages du refroidissement par eau chaude. Ils font tous leurs propres déclarations sur la température de l'eau d'alimentation de « refroidissement » pour maintenir des températures de puces adéquates et même améliorer les performances des puces par rapport au refroidissement par air traditionnel. Même lorsque ces températures ne sont pas suffisamment élevées pour remplacer directement les sources de chauffage traditionnelles (chaudières, etc.) ou pour piloter des refroidisseurs à absorption, elles restent suffisamment élevées pour réduire considérablement l'élévation requise sur les pompes à chaleur pour augmenter cette chaleur à un niveau utile. De plus, aux températures de refroidissement des liquides, il ne devrait pas être nécessaire de recourir à des refroidisseurs ou à un refroidissement mécanique. La prochaine fois, nous examinerons certains des compromis en termes d'investissement et de coûts opérationnels associés à la récolte des avantages du refroidissement par eau chaude et certains des plus grands défis sociétaux et infrastructurels.